Бесплатный фрагмент - Гений кода

Истории самых впечатляющих ИИ-проектов, которые уже меняют жизнь

Часть 1: Введение. Как читать эту книгу, чтобы изменить мышление

Глава 1. Почему мы боимся машин и восхищаемся гениями? (Психология восприятия инноваций)

Представь себе два лица.

Первое — это Альберт Эйнштейн. Лохматые волосы, добрые глаза, высунутый язык на знаменитой фотографии. Гений. Мы вешаем его постеры в комнатах, цитируем его шутки и платим деньги, чтобы посмотреть на его письма в музее. Мы им восхищаемся.

Второе лицо — безликое. Это экран монитора, на котором бегущей строкой мелькает код. А может быть, это металлическая рука робота на заводе или просто пустое поле ввода вроде ChatGPT. Мы смотрим на это и… боимся. Боимся, что завтра эта штука оставит нас без работы, обесценит наши навыки или просто сломается и натворит дел.

Странно, правда? И Эйнштейн, и нейросеть — это результат работы человеческого мозга. Но одного мы готовы обнимать, а вторую готовы воткнуть вилами, если она подойдет слишком близко.

Эта глава — наш первый сеанс психотерапии перед погружением в мир «Гениев кода». Мы не просто начнем с кнопок и матриц. Мы начнем с тебя и твоего мозга. Потому что, пока мы боимся, мы не можем учиться.

Откуда растут ноги у нашего страха?

Психологи говорят, что страх перед технологиями (технофобия) так же стар, как и сами технологии. Когда-то люди боялись книг (вдруг там дьявольщина?), потом боялись поездов (врачи викторианской эпохи всерьез считали, что у пассажиров от скорости «выпадут матки и съедут лица»), а потом боялись компьютеров.

Но с ИИ всё сложнее. Здесь работают три глубинных механизма, которые достались нам от предков.

1. Эффект «Зловещей долины» (The Uncanny Valley).

Этот термин придумал робототехник Масахиро Мори. Суть проста: пока робот похож на коробку с проводами — нам всё равно. Мы его даже можем пожалеть (помните ВАЛЛ-И?). Но как только робот становится слишком похож на человека, но с изъяном (стеклянные глаза, дерганые движения), наш мозг паникует. Срабатывает древний детектор «чужой/больной/опасность».

С ИИ то же самое. Когда нейросеть пишет откровенную ерунду — мы снисходительно улыбаемся: «глупая машина». Но когда ChatGPT выдает текст, полный боли и мудрости, а Midjourney рисует картину, от которой плачут искусствоведы, мы впадаем в ступор. Машина подошла слишком близко к «человеку», но человеком не стала. Это пугает.

2. Угроза идентичности.

Наш мозг очень любит чувствовать себя уникальным. «Человек — это звучит гордо», — говорил Горький. Мы считаем себя венцом творения именно из-за того, что умеем думать, творить, сочувствовать. Интеллект — это наша «священная корова».

И тут приходит машина и заявляет (пусть даже косвенно): «Я тоже умею думать. И писать стихи. И ставить диагнозы». Для психики это удар по самооценке вида Homo sapiens. Это страх потерять себя, свою исключительность. Это как если бы твоя собака вдруг заговорила и сказала, что она теперь главная в доме.

3. Непредсказуемость (Эффект «Черного ящика»).

Эйнштейн понятен. Он был человеком. У него была мать, которая его ругала, у него были проблемы в школе и любовницы. Мы понимаем логику человека (даже гения): страсть, голод, любопытство.

Нейросеть — это «черный ящик». Мы залили в нее гигабайты текста, нажали кнопку «обучать», и она начала выдавать результаты. Но почему она решила, что на этой картинке кошка, а не собака? Почему она выбрала именно это слово в предложении? Иногда даже инженеры, которые ее создали, не могут дать точного ответа. Мозг пугается всего, что нельзя предсказать и проконтролировать.

А почему мы тогда любим гениев?

Гений (человек) — это понятный «черный ящик». Мы верим, что даже в самой безумной идее Эйнштейна была искра божественного вдохновения или титанического труда.

История про гения — это всегда история про преодоление. Он страдал, ошибался, но встал и сделал. Это очень «человеческая» история. Она нас вдохновляет, потому что мы ставим себя на его место: «Я тоже могу страдать и ошибаться, значит, и я могу стать гением?».

Когда мы смотрим на прорыв ИИ — истории про преодоление нет. Нейросеть не страдала бессонницей, не писала сто черновиков, не плакала от критики. Она просто переработала данные. Это не вдохновляет, это пугает своей «нечеловеческой» эффективностью.

Психологический ключ к книге (Обещанный лайфхак)

Как же нам, простым смертным, читать про эти машины и не впадать в уныние или панику?

Очень просто. Нам нужно сменить фокус внимания.

На протяжении всей этой книги, читая про очередной гениальный проект, задавай себе не вопрос: «Что эта машина сделает со мной?», а вопрос: «Какой человеческий гений стоит за этим кодом?».

Смотри не на экран, а за экран.

— За AlphaGo стоит Демис Хассабис — вундеркинд, гроссмейстер в шахматы с детства, который мечтал понять, как работает разум.

— За GPT стоит сотня инженеров, которые годами бились над тем, чтобы текст был не просто правильным, а живым.

— За роботом-хирургом стоит история врача, который хотел спасать жизни, но уставала его рука.

ИИ — это не восстание машин. Это зеркало человеческого гения. Когда мы смотрим на ИИ, мы на самом деле смотрим на самих себя, просто усиленных кремнием и скоростью вычислений.

Итог главы: Снимаем страх

Итак, почему мы боимся машин? Потому что они нарушают наше чувство уникальности и непредсказуемы.

Почему мы любим гениев? Потому что мы видим в них отражение своих лучших качеств.

Твоя новая суперсила после этой главы: В следующий раз, когда услышишь новость «ИИ научился делать Х», поймай себя на страхе, а потом добавки любопытства. Спроси: «А кто тот человек или команда, которые сделали это возможным? Какой кусочек своего разума они вложили в машину?».

В этой книге мы будем рассказывать именно такие истории. Мы разберем проекты на атомы, заглянем в головы их создателей и увидим, что гениальность кода — это всегда отражение гениальности человека.

А теперь, когда твой мозг расслабился и настроился на волну восхищения, а не страха, мы можем смело нырять вглубь.

Глава 2. Метод «Трёх проекций»: Как смотреть на код (как программист), на смысл (как философ) и на выгоду (как предприниматель)

Представь, что ты держишь в руках не книгу, а волшебный фонарик. Если посветить им на стену под одним углом — увидишь скелет здания (балки и перекрытия). Под другим углом — архитектуру (красоту замысла). Под третьим — объявление о продаже (цену и выгоду).

Информация об ИИ — та же стена. Без правильного угла света ты увидишь либо скучную математику, либо страшную сказку про терминаторов, либо скучный рекламный памфлет.

Метод «Трёх проекций» — это твой личный фонарик. Его придумал не я. Его подсмотрели у великих мыслителей Возрождения. Они умели смотреть на мир глазами и инженера, и художника, и купца одновременно. Сейчас мы научимся делать то же самое с кодом.

Проекция 1: Взгляд программиста (Как это сделано?)

Это самая приземлённая, но самая честная проекция. Здесь нет места магии. Только механизмы.

Что мы ищем:

— Архитектура: Из каких «кирпичиков» собран проект? (Нейросеть, база данных, просто сложная формула?)

— Данные: На чём это учили? (На книгах, на фотографиях, на действиях людей?)

— Ошибки: Где это может сломаться? (Любой программист знает: если что-то может упасть — оно упадёт).

Вопросы, которые нужно задавать:

— Это результат труда 10 человек за месяц или 10 000 человек за год?

— Эта штука умная сама по себе, или просто ловко ищет в памяти готовые ответы?

— Могу ли я повторить это в упрощённом виде дома?

Пример:

Мы слышим: «ИИ научился писать сценарии для Голливуда!»

Взгляд программиста: «Ага. Скорее всего, это языковая модель типа GPT, которую натренировали на 10 000 голливудских сценариев. Она не придумывает сюжеты „из головы“, а комбинирует клише, которые уже были в фильмах. Если дать ей задание написать финал „Властелина колец“ в стиле Тарантино — она, вероятно, справится. Но связный трёхактный фильм с подтекстом? Сделает, скорее всего, ерунду».

Этот взгляд убивает магию, но даёт уважение к труду инженеров.

Проекция 2: Взгляд философа (Зачем это и что это меняет?)

Это самая глубокая проекция. Здесь мы отходим от кода и смотрим на последствия.

Что мы ищем:

— Смысл: Что эта технология говорит о нас, о людях? (Мы ленивы? Мы хотим жить вечно? Мы соскучились по общению?)

— Границы: Где проходит линия между человеком и машиной? (Если ИИ пишет музыку, от которой плачут — кто автор: код или композитор, написавший промт?)

— Будущее: Как изменится наше представление о норме через 10 лет?

Вопросы, которые нужно задавать:

— Если эту технологию дать каждому человеку на Земле — мир станет добрее или злее?

— Что мы теряем, когда доверяем это машине? (Например, ИИ переводит текст — мы теряем шероховатости и душу оригинала).

— Не обесценивает ли это какой-то важный человеческий навык?

Пример (продолжаем про сценарии):

Взгляд философа: «Если ИИ пишет сценарии — что происходит с профессией сценариста? Он исчезает или превращается в редактора? А зритель — ему всё равно, кто написал историю, если она цепляет? Или мы подсознательно хотим чувствовать за текстом живого человека с его болью и опытом? И ещё: если все фильмы будут написаны ИИ на основе лучших фильмов прошлого — не превратится ли кино в бесконечный ремикс самого себя? Где тогда место для настоящего „нового слова“?»

Этот взгляд расширяет сознание и не даёт технологиям застать нас врасплох.

Проекция 3: Взгляд предпринимателя (Сколько в этом денег и пользы?)

Это самая прагматичная проекция. Философия хороша за чашкой чая, но жить хочется здесь и сейчас.

Что мы ищем:

— Боль: Какую конкретную проблему людей решает эта штука? (Скуку? Трату времени? Деньги?)

— Рынок: Кто заплатит за это деньги? (Рекламодатели? Обычные пользователи? Государство?)

— Ниша: Где здесь место для меня? Могу ли я прицепиться к этому проекту и заработать?

Вопросы, которые нужно задавать:

— Это экономит время или деньги? Кому это нужно больше всего?

— Это одноразовая игрушка или сервис, к которому привыкают и не могут оторваться?

— Если я сейчас научусь с этим работать, стану ли я ценнее на рынке труда?

Пример (последний раз про сценарии):

Взгляд предпринимателя: «Голливудские студии платят сценаристам миллионы и ждут годами. Если ИИ за 5 минут накидает 10 вариантов сценария — студия сэкономит кучу времени на этапе „черновиков“. Значит, есть спрос. При этом сам ИИ ничего не стоит, но нужен человек, который умеет им пользоваться (промт-инженер). Вот она — новая работа! А ещё можно сделать приложение для начинающих режиссёров: „Напиши сценарий за 100 рублей“. Или для крупных компаний — генератор рекламных роликов под товар. Денег здесь — вагон».

Этот взгляд превращает читателя из пассивного наблюдателя в активного игрока.

Как применять метод на практике (Инструкция)

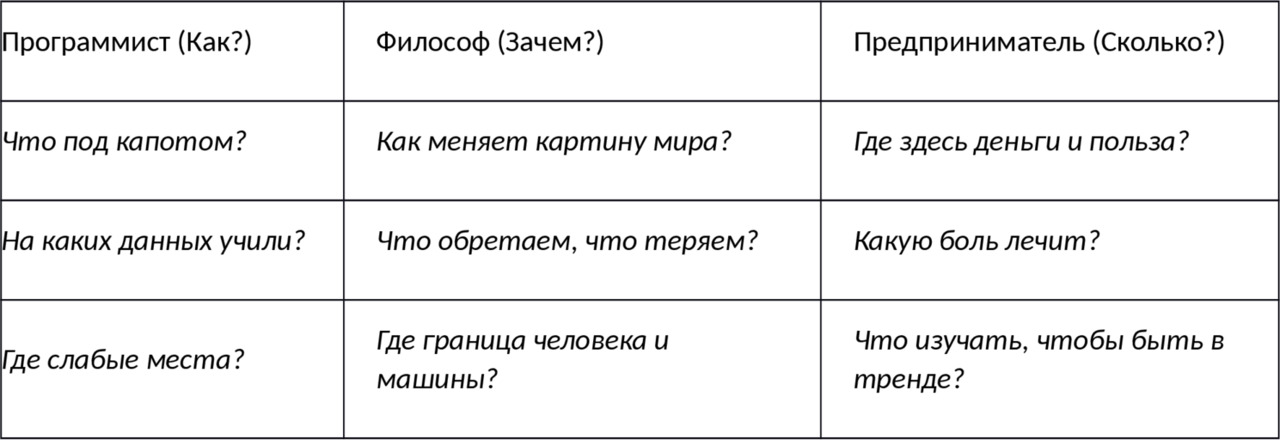

Когда ты читаешь любую главу этой книги (или новость в интернете), делай простое упражнение. Заведи мысленный «трёхколоночный журнал»:

Важный психологический секрет:

Сначала пользоваться методом будет трудно. Мозг будет лениться и соскальзывать в одну колею (обычно либо в страх, либо в восторг).

Но если ты будешь сознательно переключать проекции, произойдёт магия: ты перестанешь быть потребителем новостей. Ты станешь аналитиком реальности.

Когда вокруг все паникуют («ИИ отнимет работу!»), ты спокойно включишь проекцию программиста («пока ещё криво, без человека не работает») и философа («а может, это шанс перестать быть рабами рутины?»). Когда вокруг все ноют («всё уже придумали!»), ты включишь проекцию предпринимателя и увидишь сто ниш, которые никто не занял.

Итог главы: Три в одном

Итак, великие проекты, о которых мы будем говорить, — это не просто строчки кода.

— Для программиста — это элегантное решение инженерной задачи.

— Для философа — это новый виток в развитии цивилизации.

— Для предпринимателя — это миллиарды долларов и изменение привычек.

Твоя задача — научиться видеть все три грани одновременно. Не будь просто «технарём», который не понимает жизни. Не будь просто «мечтателем», который не умеет считать деньги. Не будь просто «торгашом», которому плевать на смыслы.

Будь Гением кода.

А теперь, когда твой фонарик настроен на три режима, давай посмотрим на него в действии. Глава 3 будет про то, как наш мозг вообще запоминает сложные вещи. Это будет полезно и для учёбы, и для жизни.

Глава 3. Как мозг запоминает сложное через истории (Нейробиология сторителлинга)

Представь, что ты держишь в руках две бумажки.

На первой написано: «Дофамин участвует в формировании мотивации и закреплении воспоминаний. Нейронные связи, активирующиеся одновременно, укрепляются». Скучно? Возможно. Запомнишь ты это? Скорее всего, нет.

На второй: «Однажды маленькая девочка обожглась, дотронувшись до горячей плиты. Её мозг в панике записал: „Плита = больно“. Больше она никогда не делала так. Нейроны, которые выстрелили вместе, связались навсегда».

Что ты запомнишь через неделю? Конечно, историю про девочку.

Почему? Потому что твой мозг — это не жёсткий диск компьютера, который бездушно сохраняет файлы. Это живой, хитрый, эволюционно старый орган, который миллионы лет выживал в саванне. И у него есть свои правила приёма информации.

Правило первое: Мозг игнорирует скуку (Роль ретикулярной формации)

В глубине твоего мозга живёт маленький сторож — ретикулярная формация. Её работа — фильтровать информацию. Каждую секунду на тебя обрушивается 11 миллионов бит информации, но сознание обрабатывает всего… 50. Сторож отсеивает всё, что неважно для выживания.

Скучная лекция, сухой текст, список фактов — сторож говорит: «Опасности нет, еды нет, секса нет, можно спать». И ты выключаешься.

А теперь история. В ней есть герой (кто-то, с кем можно себя идентифицировать). Есть конфликт или проблема. Есть эмоция. Сторон вскидывается: «Внимание! Социальная информация! Возможно, это важно для выживания в племени!» — и открывает шлюзы внимания.

Вывод: Если ты хочешь, чтобы информация усвоилась, её нужно упаковать в историю. Иначе мозг просто заснёт.

Правило второе: Мозг живёт химией (Коктейль из трёх веществ)

Когда ты слушаешь историю, твой мозг не остаётся безучастным. Он начинает варить химический коктейль, который и закрепляет воспоминания.

1. Дофамин — клей внимания.

Когда в истории нарастает напряжение, когда мы ждём развязки, мозг выбрасывает дофамин. Мы привыкли считать, что дофамин — это только про удовольствие. На самом деле это про ожидание и внимание.

Как это работает: Ты читаешь детектив и хочешь узнать, кто убийца. Дофамин заставляет тебя не отрываться от книги. А заодно он «склеивает» все факты, которые ты узнаёшь по пути, в единую цепочку.

Применительно к книге: Мы будем строить главы так, чтобы тебе хотелось узнавать «а что же дальше?».

2. Окситоцин — гормон доверия.

Когда история вызывает сочувствие к герою, когда мы чувствуем его боль или радость, мозг выделяет окситоцин.

Как это работает: Это вещество заставляет нас доверять. Если мы сопереживаем герою (учёному, который бился над задачей), мы начинаем доверять и той информации, которую он нёс.

Применительно к книге: Поэтому мы будем рассказывать про людей. Про их страхи, ошибки и триумфы. Ты будешь доверять этим историям, потому что полюбишь (или возненавидишь) героев.

3. Кортизол — маркер важности.

Когда в истории случается конфликт, опасность, боль — мозг выбрасывает кортизол. Это гормон стресса.

Как это работает: Кортизол кричит телу: «Это важно! Запомни это, чтобы выжить!». Стрессовые события запоминаются ярче всего.

Применительно к книге: Мы не будем тебя пугать, но мы покажем реальные конфликты. Борьбу человека с машиной (DeepBlue против Каспарова). Борьбу корпораций. Борьбу идей. Это создаст «кортизоловые якоря».

Правило третье: Мозг не отличает историю от реальности (Зеркальные нейроны)

Это самое удивительное открытие последних десятилетий. Итальянские учёные нашли в мозге обезьян клетки, которые загорались и когда обезьяна сама брала орех, и когда она видела, как другую обезьяну берёт орех.

Зеркальные нейроны заставляют нас проживать то, что мы видим или читаем.

Когда ты читаешь: «Он порезал палец, и кровь закапала на клавиатуру», — твой мозг активирует те же зоны, как если бы порезал палец ты. Ты чувствуешь это.

Когда ты читаешь про гения, который в отчаянии лупит кулаком по столу, потому что его код не работает сотую ночь подряд, — твои зеркальные нейроны заставляют тебя чувствовать его разочарование.

И вот магия: когда ты проживаешь эмоцию, информация записывается глубже. Ты не просто запомнил факт. Ты запомнил чувство. А чувства не стираются годами.

Как мы построим эту книгу (Обещанная схема)

Теперь ты знаешь тайный план. Почему главы в этой книге будут именно такими, а не иначе?

Каждая глава (каждый проект) будет построена по единой схеме, которая бьёт прямо в твои нейронные сети:

1. Крючок (Захват внимания).

Мы начнём не с дат и формул, а с живого момента. С кульминации. С той секунды, когда всё решилось. (Дофаминовый всплеск: «Что будет дальше?»).

2. Герой и его боль (Эмпатия).

Мы расскажем про человека. Как он ошибался, сомневался, ненавидел свой код. Ты увидишь в нём себя. (Окситоцин: «Я ему доверяю, он свой»).

3. Конфликт и преодоление (Напряжение).

Покажем настоящую проблему, которая казалась нерешаемой. Тупик. Бессонные ночи. (Кортизол: «Это важно, надо запомнить, как он выкрутился»).

4. Развязка и инсайт (Награда).

Момент «Эврика!». Как сломался старый мир и родился новый. Выброс дофамина от успеха героя — и твой мозг связывает этот успех с конкретными знаниями.

5. Твой ход (Применение).

Короткий блок про то, как этот урок применить тебе. (Переход от пассивного чтения к активному действию).

Итог главы: Стань режиссёром своего обучения

Итак, подведём итог. Если ты хочешь учиться эффективно:

— Не читай сухие инструкции. Превращай их в истории. Даже формулу Эйнштейна можно представить как драму между энергией, массой и скоростью света.

— Ищи героя. В любой технологии есть человек, который её создал. Найди его, пойми его мотивы, и ты поймёшь технологию.

— Проживай эмоции. Когда читаешь про успех — радуйся. Когда читаешь про провал — злись или грусти. Эмоция — цемент памяти.

Твой мозг создан для историй. Не борись с этим. Используй это.

А теперь, когда мы разобрались с инструментарием (метод трёх проекций) и поняли, как работает наша память, нам остался последний шаг перед погружением в мир великих проектов.

Нужно убедиться, что мы говорим на одном языке и понимаем базовые вещи. Глава 4 будет самым простым объяснением нейросетей в твоей жизни.

Глава 4. Краткий ликбез: Что такое нейросеть на пальцах (Объяснение 5-летнему ребенку)

Если ты откроешь учебник по машинному обучению, ты утонешь в математике. Градиентный спуск, функции активации, обратное распространение ошибки… Глаза закатываются, мозг плавится.

Но давай честно: чтобы понимать, как работают гениальные проекты, и чтобы применять их в жизни, тебе не нужно защищать диссертацию по высшей математике. Тебе нужно понять суть.

Поэтому выключи режим «ученика», который должен всё запомнить. Включи режим «любопытного человека». И представь, что мы сидим на кухне с чашкой чая.

Метафора первая: Ребёнок и котик

Представь маленького ребёнка. Он никогда в жизни не видел кота. Ты показываешь ему картинку с рыжим пушистым котом и говоришь: «Это кот».

Потом ты показываешь другую картинку — с чёрным гладкошерстным котом. Ребёнок думает: «Хм, цвет другой, шерсть короче, но уши похожи, и нос мокрый. Наверное, тоже кот».

Потом ты показываешь ему собаку. Ребёнок говорит: «Уши висят, язык высунут, хвост виляет. Непохоже на тех двух. Наверное, это не кот».

Позже ты показываешь тигра в книжке. Ребёнок в ужасе: «Полосатый, большой, но морда знакомая! Это огромный опасный кот!».

Вот ровно так же учится нейросеть.

— Ты показываешь ей тысячи фотографий котов (это данные).

— Ты говоришь: «Вот это — кот, а это — не кот» (это разметка).

— Нейросеть пытается угадать. Сначала она ошибается 100 раз подряд, думая, что кот — это всё подряд (колёса от машины, тарелки, люди). Но с каждой ошибкой она чуть-чуть подкручивает свои внутренние настройки, чтобы в следующий раз ошибиться меньше.

— И через тысячи попыток она вдруг начинает угадывать правильно.

Суть: Нейросеть — это не программа, которой написали правила «как выглядит кот». Это программа, которая сама вывела правила, глядя на миллион примеров.

Метафора вторая: Овощной рынок и торговка

Теперь давай заглянем внутрь нейросети. Что там?

Представь старую торговку на рынке, бабу Машу. У неё феноменальное чутьё на качество помидоров. Ты подносишь помидор, она сжимает его, нюхает, смотрит на свет и выдаёт вердикт: «Бери, сладкий» или «Не бери, кислый, пластмассовый».

Как у неё это получается? У неё внутри есть огромный опыт (те же миллионы примеров). И есть набор простых вопросов, которые она задаёт себе мгновенно:

— Вопрос первый: Цвет? (Если зелёный — сразу «нет», если красный — идём дальше).

— Вопрос второй: Упругость? (Если твёрдый как камень — «нет», если мягкий — идём дальше).

— Вопрос третий: Запах? (Если пахнет землёй — «да», если ничем не пахнет — «нет»).

Этот список вопросов называется слои нейросети. Каждый вопрос — это нейрон. Ответы на вопросы передаются дальше по цепочке.

Вот так и нейросеть. Она не думает абстрактно. Она просто проводит объект (картинку, текст, звук) через множество простых фильтров-вопросов и на выходе выдаёт ответ.

Метафора третья: Слепой скульптор (Как нейросеть обучается)

Самый сложный для понимания момент — как именно нейросеть «подкручивает настройки»? Тут поможет метафора слепого скульптора.

Представь, что тебе завязали глаза и дали кусок глины. Рядом стоит скульптура идеального кота (это идеал), но тебе её не дают трогать. Ты должен вылепить свою копию, но проверять результат будешь только на ощупь.

— Ты лепишь что-то. Подходит эксперт (это функция потерь) и трогает твою поделку. Он говорит: «Плохо. Ухо должно быть здесь, на 2 сантиметра левее». (Это ошибка).

— Ты сдвигаешь ухо. Эксперт снова трогает: «Лучше, но хвост коротковат, добавь длины».

— Ты добавляешь. Эксперт: «Хорошо, но нос слишком курносый, сделай чуть прямее».

Ты делаешь так тысячи раз, пока эксперт не скажет: «Всё, отпускай повязку, смотри — получилось!».

В мире нейросетей роль «эксперта с завязанными глазами» выполняет математический алгоритм. Он не знает, как выглядит идеал, но он знает, как посчитать разницу между тем, что получилось, и тем, что должно было получиться. И он даёт команду: «нейрон №5, увеличь свою чувствительность на 0,001%, а нейрон №6, наоборот, уменьшь». Это называется обратное распространение ошибки.

Метафора четвёртая (и самая простая): Шеф-повар и суп

Самое понятное объяснение того, чем ИИ отличается от обычной программы.

Обычная программа (как повар по книге):

Ты даёшь повару книгу рецептов. Там написано: «Возьми 2 яйца, 100 грамм муки, 50 грамм сахара, взбей, пеки 30 минут». Повар чётко выполняет. Если яйца будут мелкими, пирог может не получиться, но повар сделает всё как написано. Это программирование: ты даёшь правила, компьютер даёт результат.

Нейросеть (как повар, который учится готовить сам):

Ты приводишь повара на кухню и говоришь: «Вот продукты. Я хочу получить вот такой пирог (показываешь картинку идеального торта). Пробуй. Если получится невкусно — я скажу». Повар мешает как попало, печёт, ты пробуешь: «Фу, гадость». Повар меняет пропорции, печёт снова. Ты: «Лучше, но всё сырое внутри». И так 1000 раз. В итоге повар находит идеальную комбинацию, сам, без рецепта. Это обучение: ты даёшь примеры результата, компьютер сам находит правила.

Разрушаем главный миф

После этих метафор ты уже понял главное, но я скажу это прямо:

Нейросеть НЕ думает. Нейросеть НЕ понимает смысла. Нейросеть просто УГАДЫВАЕТ на основе прошлого опыта.

Когда ChatGPT пишет тебе стихи, он не чувствует вдохновения. Он просто перебирает миллиарды комбинаций слов, которые люди уже использовали в похожих ситуациях, и выдаёт самую вероятную.

Это как умный попугай, который слышал столько разговоров, что научился вставлять слова к месту, но понятия не имеет, что они значат.

Итог главы: Словарик для смелых

Теперь, когда мы прошли через метафоры, ты готов к трём терминам, которые будешь встречать в книге. Не пугайся их, за каждым стоит простая картинка из нашей главы.

— Нейросеть (НС) — это просто программа, которая учится на примерах, как ребёнок, а не действует по инструкции.

— Обучение — это процесс «подкручивания настроек» тысячи раз, пока ошибка не станет маленькой (как слепой скульптор).

— Данные — это те самые примеры (фотографии котов, тексты книг, голоса людей), на которых нейросеть учится. Чем больше и качественнее данные — тем умнее сеть.

Вот и всё. Теперь ты знаешь о нейросетях достаточно, чтобы понимать 90% новостей и проектов. Остальное — это просто масштаб (больше слоёв, больше данных, быстрее компьютеры).

А теперь, когда страха нет (мы поняли, что это просто сумасшедший угадайщик), инструменты есть (метод трёх проекций), память готова (мы знаем про истории), и база заложена (нейросеть — это просто сложный калькулятор)…

Мы готовы к настоящим героям!

Следующая глава будет про проект, с которого всё началось. Про студентов, которые перевернули мир компьютерного зрения с двумя видеокартами.

Часть 2: Рождение титанов. Истории прорывов, изменивших правила игры

Глава 5. AlexNet (2012): Как студент победил всех на конкурсе и начал революцию (Компьютерное зрение)

Крючок: Скука, которая изменила мир

Представь себе 2012 год. В мире ещё нет приложений, которые узнают твоё лицо, чтобы разблокировать телефон. Нет фильтров в соцсетях, которые превращают тебя в щенка. Нет машин, которые ездят сами. Если ты хотел, чтобы компьютер что-то увидел, ты должен был объяснить ему это человеческим языком: «Сначала найди края, потом углы, потом проверь, есть ли у этого уши…» Это была муторная работа программистов-ремесленников.

В это время в Торонто, в Университете, сидел аспирант по имени Алекс Крижевский. Он был родом из Украины, учился у гуру нейросетей Джеффри Хинтона и… ему было просто интересно поковыряться с железом. Буквально.

Алекс любил видеокарты. Он знал, что они созданы для игр, чтобы быстро рисовать пиксели, но в глубине души подозревал: эти штуки могут делать не только красивые картинки в Crysis, но и считать. Считать параллельно, быстро, как стая муравьёв.

В 2012 году никто в научном мире всерьёз не использовал GPU (видеокарты) для обучения нейросетей. Все работали на процессорах (CPU). Это было медленно, чинно и благородно. А Алекс взял две игровые видеокарты NVIDIA GTX 580 (каждая стоила около 500 долларов, такие же ставили геймеры для стрелялок), соединил их простым кабелем и сказал: «А давай-ка попробуем скормить им все картинки мира».

Он не знал, что эти две карты, купленные в обычном магазине, станут тем самым «ядерным реактором», который запустит эру современного ИИ.

Герои и их боль: Три мушкетёра глубокого обучения

За этим проектом стояли три человека, и каждый из них — легенда.

— Алекс Крижевский — тот самый парень, который писал код. Но он писал его не на Python, как все сейчас, а на CUDA/C++. Вручную, с нуля. Он создавал механизмы, которые обычно входят в стандартные библиотеки, своими пальцами. Это было безумно сложно, но давало максимальную скорость. Его код был произведением искусства для тех, кто понимает.

— Илья Суцкевер — ещё один аспирант Хинтона, тоже с украинскими корнями. Если Алекс был «инженером», то Илья был «архитектором». Он понимал, как заставить сеть учиться, как подбирать параметры, чтобы она не сходила с ума. Позже Илья станет сооснователем OpenAI и сделает ChatGPT, но пока это был просто талантливый парень, который верил в идею.

— Джеффри Хинтон — «крестный отец» глубокого обучения. Ему было уже под 70. Он всю жизнь, с 70-х годов, доказывал, что нейросети — это будущее, и все эти годы над ним смеялись. Его идеи считались маргинальной ересью. Но он продолжал верить и собрал вокруг себя таких же сумасшедших романтиков, как Алекс и Илья.

Их боль была огромной.

У них не было суперкомпьютера. Не было денег Google. У них были старые видеокарты и данные, которые едва влезали в память. 3 гигабайта памяти на карту — этого катастрофически не хватало, чтобы загрузить всю сеть целиком. Поэтому им пришлось пойти на хитрость: они разрезали нейросеть пополам и положили каждую половину на отдельную карту. Карты общались друг с другом только в самые важные моменты, экономя драгоценные мегабайты.

И вот так, на коленке, с паяльником в душе, они собирали бомбу замедленного действия.

Конфликт: Гонка с ветеранами

В 2012 году прошёл очередной конкурс ImageNet (ILSVRC-2012). Это была Олимпиада в мире компьютерного зрения. Участникам давали 1,3 миллиона фотографий, разбитых на 1000 категорий: от «сиамская кошка» до «стиральная машина». Нужно было научить компьютер угадывать, что на фото.

Лучшие команды мира — исследовательские центры Google, Microsoft, Oxford — бились над этой задачей годами. Они использовали классические методы: люди вручную придумывали признаки объектов (SIFT, HOG), программировали сложные алгоритмы, и те показывали результат. Лучший результат прошлого года был с ошибкой около 26%.

Команда Хинтона (они назвали себя SuperVision) подошла к старту с непонятной для всех штукой под названием «свёрточная нейросеть». Никто не верил, что эти древние концепции могут выиграть у инженерной мысли человечества.

Обучение длилось 5–6 дней. Компьютер гудел, квартира Алекса, видимо, превратилась в сауну. Они наблюдали за цифрами ошибок и не верили своим глазам: сеть училась слишком хорошо.

Развязка: Разрыв шаблона

Когда объявили результаты, академический мир взорвался. SuperVision не просто выиграла. Она уничтожила конкурентов.

— Ошибка лучших традиционных методов: 26,2%.

— Ошибка AlexNet: 15,3%.

Разрыв в почти 11% — это даже не победа, это смена эпох. Это как если бы в забеге спортсменов на стометровку вдруг прилетела ракета. С этого момента стало ясно: старые методы мертвы.

Интересно, что сначала их открытие просто проигнорировали. Ну, подумаешь, очередная нейросеть. Но когда увидели цифры, началась паника и эйфория одновременно.

Инсайт: Что они сделали такого особенного?

Гениальность Алекса, Ильи и Джеффри была не в том, что они придумали что-то космически новое. Они сделали три вещи правильно:

— Масштаб. Они поняли: нейросети работают, если они большие. 60 миллионов параметров (настроек) — это был абсурдный по тем временам объём. Все боялись таких масштабов, а они не побоялись.

— Железо. Они доказали, что видеокарты (GPU) — это новый станок индустрии. Если бы не GTX 580, обучение заняло бы не неделю, а год. Именно эта победа заставила NVIDIA обратить внимание на ИИ. Через несколько лет они станут главным бенефициаром бума нейросетей.

— Трюки против переобучения. Они использовали приём под названием Dropout — во время обучения случайно выключали половину нейронов, чтобы сеть не заучивала картинки наизусть, а училась обобщать. И функцию активации ReLU, которая ускоряла обучение в разы. Эти приёмы стали классикой.

Наследие: Всё пошло отсюда

Та самая архитектура AlexNet (8 слоёв, хитрые свёртки) стала прародительницей всего. Без неё не было бы:

— VGG, ResNet (которые победили в последующие годы).

— Распознавания лиц в iPhone.

— Теслы, которая видит дорогу.

— И даже самого ChatGPT, потому что языковые модели — это наследницы той самой идеи «масштабируем нейросети и кормим их данными».

Ирония судьбы:

После победы они основали компанию DNNResearch. Бизнес-план был простой: «У нас есть гениальный код». Через несколько месяцев Google купил эту компанию за несколько миллионов долларов. Говорят, сумма была около 50 миллионов. Хинтон, Алекс и Илья стали работать на Google.

Кстати, сам исходный код AlexNet десятилетиями считался потерянным. Он лежал в недрах Google, и только в 2024–2025 годах Музей компьютерной истории уговорил корпорацию выложить его на GitHub. Теперь любой студент может скачать код, который перевернул мир.

Твой ход: Три урока от Алекса

Что нам, простым смертным, вынести из этой истории?

— Не жди идеальных условий. У Алекса были две старые видеокарты, а не суперкомпьютер. Он использовал то, что было под рукой. Начни с тем, что у тебя есть.

— Будь на «ты» с инструментом. Алекс писал на CUDA вручную, потому что хотел выжать максимум. Тебе не нужно писать с нуля, но понимать, как работает твой инструмент (библиотеки Python, нейросети) — обязательно.

— Масштабируй гениальность. Идея была не нова. Они просто сделали её больше. Иногда прорыв — это не изобретение велосипеда, а постройка огромного завода по производству велосипедов.

P.S.

Знаешь, что самое крутое? Когда Алекс Крижевский учился, никто не давал ему грантов на «разработку революционного ИИ». Он просто занимался тем, что ему нравилось: ковырялся в коде и видеокартах. И это изменило мир.

Так что, может, твой код, который ты пишешь сегодня ночью на старом ноутбуке, — это AlexNet 2030 года?

Глава 6. DeepMind играет в Atari: Как ИИ научился играть в игры, не зная правил (Reinforcement Learning)

Крючок: Щенок перед телевизором

Представь, что ты принёс в дом маленького щенка. Он ещё ничего не знает. Ты включаешь телевизор, ставишь старую приставку Atari с игрой Breakout (это где нужно отбивать шарик платформой, разбивая кирпичи) и говоришь: «Играй».

Щенок смотрит на экран. Видит движущиеся пиксели. Видит платформу, которую можно двигать. Он не знает правил. Он не знает, что нужно отбивать мяч. Он не знает, что кирпичи нужно разбивать. Он просто тыкает лапой в джойстик.

Сначала он двигает платформу влево, вправо, просто так. Мяч падает. На экране появляется надпись «Game Over». Щенок не понимает, что случилось. Он снова тыкает. Снова мяч падает.

Но через несколько часов происходит чудо. Щенок начинает ловить мяч. Он двигает платформу туда, куда летит шарик. Ещё через несколько часов он не просто ловит, а целится так, чтобы разбить все кирпичи. А через день он находит идеальную стратегию, о которой не догадываются даже люди.

Примерно так в 2013–2015 годах мир наблюдал за тем, как программа DeepMind училась играть в 49 игр Atari, не зная ничего — только глядя на пиксели.

Герой: Вундеркинд с душой геймера

За этим проектом стоит человек с необычной судьбой — Демис Хассабис.

В 4 года он начал играть в шахматы. В 8 лет уже программировал. В 13 лет стал гроссмейстером по шахматам (второй в мире рейтинг в своей возрастной группе). В 17 лет бросил школу, чтобы работать… геймдизайнером. Да-да, он создавал игры. Одна из них — знаменитый симулятор больницы Theme Hospital, где нужно лечить смешных пациентов.

Потом он ушёл в науку, защитил диссертацию по нейробиологии (изучал, как работает память и воображение у людей) и в 2010 году основал компанию DeepMind.

Его гениальность была в синтезе:

— Он понимал, как устроены игры (как геймдизайнер).

— Он понимал, как устроен мозг (как нейробиолог).

— Он понимал, как устроен ИИ (как программист).

И он задал вопрос: «А что, если заставить компьютер учиться так же, как учится ребёнок? Не по правилам, а методом проб и ошибок?»

Конфликт: Как научить тому, чему сам не знаешь

До DeepMind все игры, в которые выигрывал компьютер, были «заточены» под конкретную задачу. Deep Blue обыграл Каспарова, но не умел играть даже в крестики-нолики. Это были узкие специалисты.

Хассабис хотел создать общий интеллект — программу, которая сможет научиться чему угодно, просто глядя на экран.

Но как это сделать? Если ты учишь нейросеть распознавать котов, ты показываешь ей котов и говоришь: «Вот кот, молодец». А здесь нет правильных ответов. Есть только экран, джойстик и счёт в углу. Ты даже не знаешь, какой ход правильный, потому что результат может наступить через 1000 шагов.

Представь, что ты учишь кого-то играть в шахматы, но не говоришь правила и не показываешь, как ходят фигуры. Ты просто даёшь джойстик и говоришь: «Смотри на экран и крути. Если в конце счёт вырастет — значит, ты делал что-то правильно». Как тут вообще можно чему-то научиться?

Развязка: DQN — игрок, который запоминает сны

Команда DeepMind придумала элегантное решение. Они создали систему под названием Deep Q-Network (DQN).

В ней было три гениальных компонента.

Компонент 1: Глаза (Свёрточная нейросеть).

Как и в AlexNet, DQN использовала нейросеть, которая смотрела на пиксели. Она училась распознавать на экране важные объекты: мяч, платформу, кирпичи, врагов. Это был её «зрительный котелок».

Компонент 2: Инстинкт (Q-learning).

Второй компонент — это математический метод, который оценивал, насколько хорошо совершить то или иное действие в данной ситуации. Скажем, если мяч летит влево, то нажать «влево» — это хорошо (+10 баллов к будущей победе), а нажать «вправо» — глупо (-100 баллов). Нейросеть училась предсказывать эту «ценность» каждого действия.

Компонент 3: Память снов (Experience Replay).

Это был главный трюк. Обычно, когда мы учимся, мы учимся на последовательности событий. Но в играх события сильно связаны: 100 кадров подряд мяч просто летит. Если учиться на этом, нейросеть «зациклится» и будет думать, что мир всегда такой.

DeepMind придумали гениально простую вещь: они заставили программу запоминать свой игровой опыт (действие, ситуацию, награду) в специальный «буфер памяти». А потом, во время обучения, они не кормили её последними кадрами, а случайно выбирали кусочки из всей памяти.

Это как если бы ты учился играть на гитаре не просто повторяя одно и то же упражнение, а вспоминая все свои попытки за месяц — и удачные, и провальные — и анализируя их вперемешку. Мозг так не делает, но для машины это оказалось секретом успеха.

Инсайт: Момент, когда мир ахнул

В 2013 году DeepMind показала первые результаты на семи играх. В 2015 году вышла статья в журнале Nature про 49 игр. Результаты были сенсационными.

— Breakout (Арканоид): Сначала программа играла хуже ребёнка. Через 2 часа — как средний игрок. Через 4 часа она нашла идеальную стратегию: пробить дыру в боку, загнать мяч за стену кирпичей и дать ему там летать, снося всё подряд. Люди до этого додумывались не сразу.

— Pong (теннис): Обыграла человека всухую.

— Space Invaders: Набрала в 2–3 раза больше очков, чем профессиональный игрок.

— Video Pinball (пинбол): Превысила человеческий результат в 200 раз.

Из 49 игр DQN показала результат лучше предыдущих алгоритмов в 43 играх, а в половине случаев играла лучше человека.

Куда не дотянулся гений

Конечно, были и провалы. Самая знаменитая игра, в которой DQN опозорилась, — Montezuma’s Revenge («Месть Монтесумы»).

Это бродилка, где нужно собирать ключи, открывать двери, избегать ловушек. Награда (очки) выпадает очень редко — только когда ты нашёл сокровище в конце уровня. Между первым шагом и наградой — сотни действий. Нейросеть не могла понять, какое именно действие привело к успеху. Она просто тыкалась как слепая и умирала.

Это показало важную вещь: DQN отлично работает там, где награда частая и понятная, но пасует перед долгосрочным планированием. (Эту проблему потом будут решать другие архитектуры).

Сделка века: Google платит 650 миллионов

Самое забавное в этой истории — как DeepMind купили.

В 2014 году, ещё до публикации в Nature, Хассабис пришёл на переговоры с Google. Он показал демо: программа играет в Breakout, сама учится, находит стратегии.

Ларри Пейдж (сооснователь Google) смотрел и не мог поверить своим глазам. Он понял, что это не просто игра. Это технология, которая может оптимизировать всё: от охлаждения дата-центров до показа рекламы.

Google купила DeepMind за 400 миллионов фунтов стерлингов (около 650 миллионов долларов). Для компании, у которой не было готового продукта, а были только идеи и пара статей, это было невероятно.

Наследие: От Atari к AlphaGo и дальше

Именно технология DQN стала фундаментом для всего будущего DeepMind:

— AlphaGo (2016), обыгравшая чемпиона мира по го, использовала те же принципы обучения с подкреплением, только усложнённые.

— AlphaFold, решившая задачу сворачивания белков, тоже наследница этой философии.

— Оптимизация серверов Google: DQN научили экономить электроэнергию на охлаждении (об этом будет отдельная глава).

Твой ход: Чему нас учит история с приставкой

— Награда должна быть понятной. Если ты хочешь чему-то научиться (или научить нейросеть), нужна частая и честная обратная связь. Без неё даже гений заблудится, как в Montezuma’s Revenge.

— Ошибки — это опыт. Метод «воспроизведения опыта» (Replay) — гениальная метафора для жизни. Иногда полезно не просто мчаться вперёд, а остановиться, вспомнить свои прошлые действия (и удачные, и нет) и понять, что сработало, а что нет.

— Синтез — сила. Хассабис победил не потому, что был лучшим программистом, а потому что понимал игры, мозг и математику одновременно. Самые крутые прорывы случаются на стыке дисциплин.

P.S.

Знаешь, что сказал Демис Хассабис, когда его спросили, зачем он учит ИИ играть в игры?

«Игры — это идеальная песочница для интеллекта. Если мы научимся создавать интеллект в игре, мы сможем применить его в реальности: в медицине, энергетике, науке».

Оказалось, он не шутил.

Глава 7. AlphaGo и матч с Ли Седолем: «Божественный ход», который потряс человечество

Крючок: 15 секунд, изменивших всё

9 марта 2016 года, Сеул. В конференц-зале отеля «Фор Сизонс» тишина, которую нарушает только стук камней о деревянную доску. За столом сидит Ли Седоль — легенда, 18-кратный чемпион мира по игре Го, живое национальное достояние Кореи. Напротив него — пустота. Только камера, направленная на доску, и динамик, через который транслируются ходы соперника.

Соперник — программа AlphaGo, созданная британской компанией DeepMind, которую недавно купил Google.

Идёт вторая партия. Счёт 0:1 в пользу AlphaGo — Ли Седоль уже проиграл первую партию, что само по себе было шоком. Но сейчас, на 37-м ходу второй партии, происходит нечто странное.

AlphaGo делает ход. Камень ложится в точку, которую комментаторы называют «невозможной». Один из профессиональных игроков, комментирующий матч в прямом эфире, говорит: «Это ошибка. Программа сломалась. Так не ходят люди».

Ли Седоль на мгновение замирает. Ему нужно принять решение. Он не знает, что этот ход войдёт в историю под именем «Божественный ход». Он не знает, что этот момент изменит всё.

Он выходит из зала покурить. Ему нужно подумать.

А в это время по всему миру трансляцию смотрят миллионы людей, и никто ещё не понимает: они стали свидетелями момента, когда машина сделала то, что не мог сделать ни один человек за тысячелетия игры.

Герой: Последний бастион человеческого разума

Чтобы понять драму, нужно понять, что такое игра Го.

Го — это древняя китайская игра, которой больше 2500 лет. Правила просты: два игрока ставят чёрные и белые камни на пересечения линий, пытаясь окружить территорию. Но сложность этой игры — космическая.

В шахматах после каждого хода есть около 35 вариантов. В Го — 250 вариантов. Количество возможных позиций в Го больше, чем количество атомов во Вселенной. Тысячелетиями считалось, что машина никогда не сможет обыграть человека в Го, потому что здесь нужна не просто сила перебора, а интуиция. Чувство красоты. Понимание формы.

Ли Седоль был воплощением этой интуиции. Он стал профессионалом в 12 лет. Он выигрывал всё, что можно. В Корее его боготворили. Когда стало известно о матче с программой, он был уверен в победе. «Я выиграю 5:0 или 4:1», — сказал он перед началом. «Люди интуитивно чувствуют игру, а машина — нет».

Он не знал, что через несколько дней будет плакать.

Конфликт: Две философии интеллекта

AlphaGo, созданная командой Демиса Хассабиса (того самого, что играл в Atari), была принципиально новой машиной. Она не была «запрограммирована» на игру в Го. Её учили по-другому.

Как учили AlphaGo:

— Сначала она смотрела на людей. Ей скормили 30 миллионов ходов, сделанных профессиональными игроками. Она училась предсказывать: «Если позиция такая, то человек скорее всего сходит сюда». Это называется обучение с учителем. Она впитала всю мудрость человечества за 2500 лет.

— Потом она начала играть сама с собой. Миллионы партий, днём и ночью, без остановки. Она играла с копией себя, училась на своих ошибках, находила новые стратегии, которые никогда не приходили в голову людям. Это называется обучение с подкреплением.

— У неё были две нейросети внутри. Одна — «Политика» — предлагала, куда сходить. Вторая — «Ценность» — оценивала, насколько хороша позиция в долгосрочной перспективе. Они спорили друг с другом, и рождалась истина.

К марту 2016 года AlphaGo сыграла сама с собой столько партий, сколько человек не сыграет за миллион лет.

Развязка: Пять партий, потрясших мир

Матч из пяти партий транслировался на видеохостинге. Комментаторами были профессиональные игроки Го. Зрителями — весь мир.

Партия 1: Шок

AlphaGo выиграла. Ли Седоль ошибался? Нет, он играл сильно. Но программа играла сильнее. Мир ахнул, но решил: «Первая партия, разведка. Дальше будет легче».

Партия 2: Божественный ход (37-й ход)

И вот он, тот самый момент. 37-й ход чёрными. AlphaGo поставила камень в точку, которая считалась не просто плохой, а немыслимой для профессионалов. Комментаторы в студии сказали: «Это ошибка программы». Они даже попытались найти объяснение: «Может, там баг?».

Но по мере развития партии стало понятно: это был не баг. Это был гений. Этот камень оказался ключевым. Он создавал невидимые глазу человека угрозы на 50 ходов вперёд. Комментаторы замолчали, потом начали говорить: «Мы никогда не видели такого хода за 1000 лет игры».

Ли Седоль проиграл вторую партию. Счёт 0:2.

Партия 3: Унижение

Третья партия. Ли Седоль играет изо всех сил, но AlphaGo снова побеждает. Счёт 0:3. Матч проигран досрочно. В зале тишина. Ли Седоль выглядит потерянным. Он извиняется перед зрителями. Он говорит: «Я чувствую себя бессильным».

Партия 4: Слёзы и триумф человека

И тут происходит то, чего не ждал никто. Ли Седоль собирается. Он делает ход, который потом назовут «Ход Бога» (или «Ход Ли Седоля»). На 78-м ходу четвёртой партии он ставит камень в сложнейшую позицию.

AlphaGo сбивается. Программа, которая никогда не ошибается, начинает делать странные ходы. Алгоритм подсчёта вероятности победы резко падает. Впервые за матч AlphaGo проигрывает.

Ли Седоль выигрывает. Он плачет. Зал аплодирует стоя. Комментаторы рыдают в эфире. Человек победил машину.

Партия 5: Финал

Пятая партия была напряжённой, но AlphaGo восстановилась и выиграла. Итог матча: 4:1 в пользу машины.

Инсайт: Что случилось с AlphaGo в четвёртой партии?

Почему машина, которая обыграла чемпиона, вдруг проиграла? Ответ прост и сложен одновременно.

Ход Ли Седоля был настолько нестандартным, настолько человечным, что вывел AlphaGo из зоны комфорта. Программа не видела такого хода в миллионах партий, которые она сыграла сама с собой. Она просто не знала, как на него реагировать. Это был творческий акт, который сломал алгоритм.

Демис Хассабис потом скажет: «Это был гениальный ход. Ли Седоль нашёл единственную слабость в нашей системе. Он играл как человек, а не как машина».

Божественный ход (37-й) — взгляд изнутри

А что насчёт того самого 37-го хода? Почему его назвали божественным?

Профессиональные игроки Го объясняют это так: человек мыслит «паттернами». Мы видим привычные формы, стандартные построения. Мы знаем, что «так не ходят», потому что так не учили.

AlphaGo не знала слова «нельзя». Она просто посчитала вероятности. И вероятность победы при этом ходе оказалась выше, чем при «правильных» ходах. Она нашла решение, которое лежало за пределами человеческого опыта.

Это был момент, когда машина показала человеку: «Ваша мудрость, накопленная веками, — это лишь частный случай. Есть другие миры, о которых вы даже не догадываетесь».

Наследие: После матча

Что стало с героями?

AlphaGo больше никогда не играла с людьми. DeepMind объявила о «выходе на пенсию» программы в 2017 году. Но перед этим она сыграла с собой 50 партий, которые были опубликованы как «шедевры». Сегодня любой игрок может изучать эти партии, как шахматисты изучают партии Каспарова. AlphaGo изменила игру Го навсегда. Появились новые дебюты, новые стратегии. Люди стали играть лучше, глядя на машину.

Ли Седоль ушёл из профессионального спорта в 2019 году. Он сказал: «С появлением ИИ понял, что я больше не на вершине. Есть существо, которое невозможно победить». Но в 2023 году он объявил о возвращении, чтобы сыграть с… другими людьми. С машинами он больше никогда не играл. В интервью он говорит, что гордится той одной победой, потому что это была победа человеческого духа.

Человечество получило важнейший урок. Мы поняли, что интуиция — это не магия. Это тоже результат обработки данных, просто очень быстрой и неосознаваемой. И что машины могут создавать новое, то, чего не было в обучающей выборке.

Твой ход: Четыре урока от Ли Седоля и AlphaGo

— Не бойся выходить за рамки. 37-й ход AlphaGo был невозможен с точки зрения традиции. Но он сработал. В твоей работе, творчестве, жизни — ищи «невозможные ходы».

— Цени человеческое. Ход Ли Седоля в четвёртой партии был гениален именно потому, что был человеческим. Нестандартным, интуитивным, отчаянным. Машины учатся на данных. Люди умеют делать то, чему их не учили.

— Учись у машин. Сегодня профессиональные игроки в Го изучают партии AlphaGo. Ты тоже можешь смотреть, как ИИ пишет код, рисует или пишет тексты, и находить там новые приёмы.

— Принимай поражение с достоинством. Ли Седоль проиграл, но не сломался. Он выиграл одну партию, и этого хватило, чтобы войти в историю. Иногда одна победа важнее десяти титулов.

P.S.

Когда Ли Седоля спросили, что он чувствовал после 37-го хода во второй партии, он ответил:

«Сначала я подумал, что это ошибка. Потом я подумал, что надо покурить. А потом я понял, что смотрю на доску и не понимаю, что происходит. Я играл в Го 30 лет, но никогда не видел такой красоты».

Это и есть момент встречи человека и сверхинтеллекта — когда ты перестаёшь бояться и начинаешь восхищаться.

Глава 8. WaveNet: Как Google научил машину говорить с человеческими интонациями (Синтез речи)

Крючок: Звонок от мамы

Представь, что тебе звонит мама. Ты снимаешь трубку, слышишь родной голос, интонации, дыхание, может быть, лёгкую хрипотцу. Она говорит: «Привет, сынок, как дела? Ты поел?» Ты отвечаешь, расслабляешься, потому что это свой, родной человек.

А потом выясняется, что это был не человек. Это был робот. Он сгенерировал голос твоей мамы в реальном времени, сымитировал её манеру говорить, её паузы, её дыхание. И ты купился.

Звучит как сценарий фильма ужасов? Возможно. Но именно к этому миру нас привела технология, которая называется WaveNet.

А начиналось всё с простой задачи: сделать так, чтобы роботы перестали звучать как роботы.

Герои: Британские учёные, которым надоел металлический голос

В 2016 году в Лондоне, в офисе DeepMind (той самой компании, которая обыграла Ли Седоля в Го), сидела команда исследователей. Они занимались разными вещами: играми, логикой, планированием. Но была одна проблема, которая раздражала всех: синтез речи.

В то время все голосовые помощники — Siri, Google Now, Алиса (в будущем) — звучали… как роботы. Да, они были понятны. Да, они могли прочитать текст. Но это был мёртвый звук. Он резал слух.

Почему? Потому что все существующие системы синтеза речи работали по одному из двух принципов:

— Компиляция (Concatenative synthesis). Берётся огромная библиотека записей реального диктора, режется на кусочки (фонемы, слоги), а потом эти кусочки склеиваются как конструктор. Звучит дёргано, потому что интонации на стыках не совпадают.

— Параметрический синтез (Parametric synthesis). Компьютер генерирует звук по математическим формулам: частота, амплитуда, длительность. Это звучит как «говорящий калькулятор» — плоско и неестественно.

Команда DeepMind задала вопрос: «А что, если не склеивать и не считать по формулам? Что, если заставить нейросеть научиться говорить, как человек? С нуля, генерируя звук по сэмплу, точка за точкой?».

Конфликт: Почему звук — это сложно

Звук — это не слова. Слова — это просто символы. Звук — это физика. Это колебания воздуха, которые мы измеряем 16 000 или 44 100 раз в секунду (частота дискретизации).

Чтобы сгенерировать 1 секунду речи, нейросеть должна предсказать 16 000 значений (сэмплов). И каждый следующий сэмпл зависит от предыдущих. Это как если бы ты писал бесконечную цепочку, где каждое следующее слово зависит от предыдущих 16 000.

Проблема в том, что существующие нейросети (рекуррентные, LSTM) плохо справлялись с такой длинной зависимостью. Они «забывали» начало предложения к тому моменту, как доходили до конца. А для интонации важна вся фраза целиком.

Кроме того, человеческий голос — это не просто частота. Это:

— Дыхание (вдохи перед фразами).

— Интонация (повышение и понижение тона).

— Акценты (выделение важных слов).

— Эмоции (радость, грусть, сарказм).

— Паузы (заполненные и незаполненные).

Ни одна из существующих систем не умела это моделировать. Они выдавали «мёртвый» текст.

Развязка: Гениальная простота

Команда DeepMind (Аарон ван ден Оорд, Карен Симонян и другие) придумала архитектуру, которую назвали WaveNet.

Идея была обманчиво проста: они взяли свёрточные нейросети (те, что используются для распознавания картинок) и применили их к звуку. Но не просто свёрточные, а дилатированные (dilated) свёртки.

Что это значит?

Обычная свёртка смотрит на соседние пиксели. В звуке — на соседние сэмплы. Но чтобы охватить длинные зависимости (например, интонацию всего предложения), нужно смотреть далеко вперёд и назад.

Дилатированная свёртка — это как если бы ты смотрел на звук не подряд, а с шагом: сначала на каждый сэмпл, потом на каждый второй, потом на каждый четвёртый, шестнадцатый и так далее. Это позволяло сети «видеть» и микро-детали (шёпот, шипение), и макро-структуру (ритм фразы) одновременно.

Они сложили много таких слоёв друг на друга (как слоёный пирог), и сеть научилась предсказывать следующий звук на основе всех предыдущих, даже очень далёких.

Второй гениальный трюк: они не просто генерировали звук. Они генерировали распределение вероятностей для каждого следующего сэмпла.

То есть нейросеть не говорила: «Следующий звук будет такой-то». Она говорила: «С вероятностью 70% это будет звук А, с вероятностью 20% — звук Б, с вероятностью 10% — звук В». А потом они выбирали случайно из этого распределения.

Зачем? Чтобы голос звучал естественно. Если выбирать всегда самый вероятный вариант, голос становится слишком «механическим», как автопилот. Если добавить случайность — появляются те самые живые вариации, которые делают речь человеческой.

Инсайт: Момент, когда робот задышал

В 2016 году DeepMind опубликовала статью и демо-записи. Люди, слушавшие их впервые, не могли поверить своим ушам.

Голоса, сгенерированные WaveNet, звучали лучше, чем записи реальных дикторов в существующих системах. Тесты показали, что люди предпочитают WaveNet и реальным записям (потому что реальные дикторы иногда устают и ошибаются), и уж тем более другим синтезаторам.

Но самое потрясающее было в другом.

WaveNet научилась не просто читать текст. Она научилась:

— Имитировать акценты. Ей давали запись человека с ирландским акцентом, и она говорила с ирландским акцентом.

— Передавать эмоции. Она могла говорить сердито, радостно, грустно — если её обучить на соответствующих записях.

— Генерировать дыхание. В паузах между фразами слышно, как диктор делает вдох. Это то, что ни одна система раньше не делала.

А ещё WaveNet научилась генерировать музыку и звуки. Если её обучить на фортепианных записях, она могла сочинять новые мелодии в том же стиле. Если обучить на звуках дождя — она генерировала бесконечный дождь, который звучал как настоящий.

Проблема: Гениальное нельзя запустить

У WaveNet была одна огромная проблема, которая делала её коммерчески непригодной в 2016 году.

Скорость.

Чтобы сгенерировать 1 секунду звука, WaveNet требовалось несколько минут вычислений на мощном процессоре. Потому что она генерировала сэмпл за сэмплом, последовательно, и каждый сэмпл проходил через огромную нейросеть.

Это было как если бы ты хотел послушать аудиокнигу, а тебе приходилось ждать неделю, пока компьютер её наговорит. Для реального использования (Google Assistant, озвучка видео) это было невозможно.

DeepMind пришлось искать компромиссы. Они создали упрощённую версию (Parallel WaveNet), которая использовала вторую нейросеть для «дистилляции» знаний и могла генерировать звук параллельно, в реальном времени.

Наследие: Революция в голосе

WaveNet изменила всё. После неё:

— Google Assistant заговорил новым, живым голосом. Теперь его стало сложно отличить от человека по коротким фразам.

— Амазонка и Apple бросились догонять. Началась гонка голосов.

— Появились коммерческие сервисы синтеза речи (Murf.ai, ElevenLabs), которые делают голоса, неотличимые от человеческих.

— Началась эра дипфейков голоса. Технология, созданная для удобства, быстро стала инструментом мошенников. Сегодня аферисты могут позвонить вам голосом вашего начальника и попросить перевести деньги.

Темная сторона: Когда голос крадут

Самое страшное применение WaveNet и её последователей — это синтез голоса конкретного человека.

Достаточно 3–5 минут записи чужого голоса (из видео, интервью, случайного разговора), чтобы нейросеть научилась говорить так же. Мошенники звонят родственникам и паническим голосом просят выкуп. Журналистов дискредитируют фейковыми высказываниями. Бизнесменов обманывают, имитируя голос партнёров.

WaveNet открыла ящик Пандоры. Мы вступили в эру, где голосу больше нельзя доверять. Если ты не видишь человека своими глазами — ты не можешь быть уверен, что это он.

Твой ход: Четыре урока от WaveNet

— Гениальность в деталях. WaveNet победила не потому, что придумала что-то космическое, а потому что научилась учитывать все детали: дыхание, паузы, интонации. В твоей работе тоже: успех часто в мелочах, которые другие игнорируют.

— Скорость имеет значение. Самая гениальная технология бесполезна, если её нельзя применить в реальной жизни. Всегда думай о том, как твоё решение будет работать «в поле».

— Технология нейтральна. WaveNet создавали, чтобы помочь слепым людям «читать» тексты или чтобы Алиса звучала приятнее. А теперь ею пользуются мошенники. Помни: любой инструмент можно использовать во благо и во зло.

— Проверяй реальность. Если тебе позвонили с неожиданной просьбой о деньгах — перезвони сам, напиши в мессенджер, спроси то, что знаете только вы двое. Доверие к голосу умерло.

P.S.

Знаешь, что сказал один из создателей WaveNet, когда его спросили про мошенников?

«Мы создавали технологию, чтобы помогать людям. То, как её используют другие, — это вопрос образования и законодательства. Но остановить прогресс нельзя. Мы можем только научиться жить в новом мире».

Глава 9. BERT and Co.: Как модели научились читать контекст (Понимание языка)

Крючок: Загадка про банк

Представь, что ты даёшь компьютеру два предложения:

— «Я пошёл в банк, чтобы положить деньги на счёт.»

— «Мы сидели на банке в парке и ели мороженое.»

Для человека это элементарно. В первом случае — финансовое учреждение, во втором — скамейка. Но для машины до 2018 года это была катастрофа. Слово «банк» — это просто набор букв. У него нет значения само по себе. Значение появляется только из контекста.

До появления BERT компьютеры читали текст как мешок слов. Они не понимали, что порядок важен. Они не понимали, что слово может менять смысл в зависимости от соседей. Они были как дислексики, которые видят буквы, но не схватывают суть.

А потом в Google пришла команда исследователей и сделала то, что изменило всё.

Герои: Невидимые гении из Маунтин-Вью

В отличие от DeepMind с их громкими пиар-кампаниями, команда, создавшая BERT, работала в тени. Это были инженеры и исследователи из Google AI Language.

Их имена — Джейкоб Девлин, Мин-Вей Чанг, Кентон Ли, Кристина Тутанова — известны в основном специалистам. Они не играли в Го на глазах у всего мира. Они просто делали свою работу: улучшали поиск Google.

Проблема, которую они решали, была мучительной для всей компании. Google зарабатывает деньги на поиске. А поиск — это понимание того, что ищет пользователь. Если поисковая система не понимает смысла запроса, она показывает ерунду. А пользователи уходят к конкурентам.

К 2018 году все поисковики работали примерно одинаково: они смотрели на слова в запросе и искали страницы, где эти слова встречаются. Это была эра keyword matching. Но люди так не мыслят. Люди мыслят смыслами.

Конфликт: Почему старые модели были глупыми

До BERT все языковые модели работали по одному из двух принципов:

1. Bag of Words (Мешок слов).

Предложение превращалось в набор слов без порядка. «Мама мыла раму» и «Рама мыла маму» для такой модели были одинаковыми. Абсурд, но факт.

2. Односторонние модели (RNN/LSTM).

Они читали текст слева направо и предсказывали следующее слово. Но у них была проблема: они «видели» только прошлое, но не будущее. А для понимания контекста нужно видеть и то, что было ДО, и то, что будет ПОСЛЕ.

Пример: «Он пошёл в банк, потому что ему нужно было…».

Чтобы понять, какой банк имеется в виду, нужно знать, что будет дальше: «… положить деньги» или «… починить штаны». Односторонняя модель этого не умела. Она гадала вслепую.

Исследователи Google задали простой вопрос: «А что, если научить модель смотреть на текст с двух сторон одновременно? Что, если дать ей читать как человек?».

Развязка: BERT — дворецкий, который понимает всё

BERT (Bidirectional Encoder Representations from Transformers) — это архитектура, которая совершила революцию.

Название расшифровывается как «Двунаправленные представления кодировщика от трансформеров». Звучит страшно, но суть проста.

Гениальная идея №1: Двунаправленность.

BERT читает текст сразу весь. Он не идёт слева направо. Он смотрит на все слова в предложении одновременно и для каждого слова учитывает все остальные — и слева, и справа.

Как это работает? Представь, что ты разгадываешь кроссворд. У тебя есть слово из 5 букв, и тебе нужно его угадать. Ты смотришь на соседние слова по вертикали и горизонтали. Ты учитываешь всё сразу. Примерно так же работает BERT.

Гениальная идея №2: Маскировка (Masked Language Model).

Как научить модель понимать контекст, если у тебя нет правильных ответов? В обычном языке нет размеченных данных.

Хитрость: они прятали 15% слов в предложении и заставляли модель угадывать спрятанное.

Например: «Я пошёл в [MASK], чтобы положить деньги.»

Модель должна понять по контексту, что спрятано слово «банк» (финансовый), а не «парк» или «магазин».

Когда модель учится угадывать спрятанные слова, она невольно учится понимать, как слова связаны друг с другом. Она впитывает в себя грамматику, семантику, контекст. Это называется self-supervised learning — самообучение без учителя.

Гениальная идея №3: Трансформеры.

BERT построен на архитектуре Transformer, которая была придумана в Google чуть раньше (знаменитая статья «Attention Is All You Need», 2017). Трансформеры позволяют модели обрабатывать все слова параллельно (а не последовательно, как старые сети) и использовать механизм внимания (attention) — то есть фокусироваться на важных словах в предложении, даже если они далеко друг от друга.

Инсайт: Момент, когда поиск поумнел

В 2018 году Google опубликовала статью про BERT и одновременно выложила код в открытый доступ.

Это был гениальный бизнес-ход. Google могла держать технологию в секрете и пользоваться сама. Вместо этого они открыли исходники. Почему? Потому что BERT — это не продукт. Это фундамент. Google хотела, чтобы весь мир начал строить на этом фундаменте, чтобы экосистема росла, а Google оставалась лидером.

Эффект был мгновенным. BERT побил все рекорды в 11 задачах понимания языка (GLUE benchmark). То, что казалось невозможным вчера, стало реальностью сегодня.

А в 2019 году Google объявила, что BERT работает в поиске. Это было самое большое изменение в алгоритмах поиска за последние 5 лет.

Что это значило для обычных людей?

Раньше, если ты искал «2019 бразилия путешественник забрался в аптеку», Google искал слова «2019», «бразилия», «путешественник», «забрался», «аптека». И находил чёрт знает что.

С BERT Google начала понимать, что предлог «в» меняет смысл. Что «забраться в аптеку» — это не то же самое, что «купить в аптеке». Что контекст важен.

Вот пример, который приводила сама Google:

Запрос: «Do estheticians stand a lot at work?» (Много ли стоят косметологи на работе?)

Раньше Google показывала страницы про «стоячую работу» вообще. BERT понял, что важно слово «estheticians» (косметологи), и выдал точный ответ именно про эту профессию.

Война гигантов: BERT против всех

Успех BERT породил гонку вооружений. Все захотели свою «понимающую» модель.

— OpenAI выпустила GPT (Generative Pre-trained Transformer). Но их модель была односторонней (слева направо). Она лучше генерировала текст, но хуже понимала контекст.

— Фейс выпустил RoBERTa — улучшенную версию BERT (больше данных, дольше обучение, хитрее настройки).

— Microsoft выпустила MT-DNN, Turing-NLG.

— Google не остановилась: вышли ALBERT (лёгкий BERT), T5 (Text-to-Text Transfer Transformer) — модель, которая умела делать всё: переводить, отвечать, обобщать, просто превращая любую задачу в текст.

Каждая новая модель была больше, мощнее и требовала больше вычислительных ресурсов. Если первые версии BERT имели 110 миллионов параметров, то современные модели (GPT-3) доросли до 175 миллиардов.

Темная сторона: Размер имеет значение?

У этого бума был обратный эффект.

1. Экологический. Обучение большой языковой модели выделяет столько же CO2, сколько 5 автомобилей за весь срок службы. Гонка гигантов стала угрожать климату.

2. Элитарный. Только суперкорпорации (Google, Microsoft…) могли позволить себе обучать такие модели. Университеты и стартапы выпали из гонки. Наука из открытой стала закрытой.

3. Невменяемый. Модели стали настолько большими, что никто до конца не понимает, как они работают внутри. Мы знаем, что на входе и что на выходе, но что происходит между ними — «чёрный ящик».

Наследие: Без BERT не было бы ChatGPT

BERT и его последователи создали фундамент для всего, что мы имеем сейчас.

— Поисковики стали умными. Яндекс тоже внедрил свои аналоги.

— Голосовые помощники начали понимать сложные запросы.

— Анализ тональности (определение эмоций по тексту) вышел на новый уровень.

— Машинный перевод перестал быть корявым.

— И самое главное: BERT доказал, что контекст — это всё.

А потом, через несколько лет, на этом фундаменте построили ChatGPT. Но об этом позже.

Твой ход: Четыре урока от BERT

— Смотри на проблему с двух сторон. Одностороннее мышление — главный враг понимания. Всегда ищи контекст, всегда смотри на ситуацию с разных углов.

— Учись угадывать спрятанное. Метод маскировки (предсказание пропущенного) — отличный способ учиться чему угодно. Когда ты сталкиваешься с неполной информацией, попробуй восстановить целое. Это тренирует мозг.

— Открытость порождает экосистему. Google открыла BERT — и весь мир начал работать на их технологии. Иногда выгоднее поделиться, чем спрятать.

— Размер — не главное. BERT был прорывом не потому, что был огромным, а потому что был умным. В погоне за масштабом не забывай про качество архитектуры.

P.S.

Знаешь, что самое забавное? Когда BERT только вышел, многие критики говорили: «Ну, понимание контекста — это круто, но до настоящего интеллекта ещё далеко». Они были правы. Но они не знали, что семена уже посеяны.

Всего через несколько лет те же принципы (трансформеры, внимание, контекст) приведут к появлению моделей, которые будут писать поэмы и сдавать экзамены в Стэнфорде.

Глава 10. GANs (Состязательные сети): История про художника и критика, которые создают идеальные подделки

Крючок: Лицо, которого нет

Зайди на сайт ThisPersonDoesNotExist.com. Нажми F5. Ты увидишь лицо человека. Красивого, живого, с морщинками, родинками, эмоциями. Нажми ещё раз — новое лицо. Ещё раз — новое.

Ни одного из этих людей не существует в реальности. Никогда не существовало. Это чистая генерация нейросети. Они не родились, не ходили в школу, не любили, не страдали. Их просто нарисовала машина.

А теперь самое страшное: ты не можешь отличить их от реальных фотографий. Твой мозг обманут. И это сделала технология под названием GAN.

Герой: Канадец, которого достала скука

История GAN началась в 2014 году в Монреале. Молодой исследователь по имени Ян Гудфеллоу (Ian Goodfellow) работал в лаборатории знаменитого Йошуа Бенжио (одного из «трёх китов» глубокого обучения).

По легенде (а Гудфеллоу подтверждает её в интервью), идея пришла к нему в баре.

Они сидели с друзьями после защиты диссертации одного из коллег. Разговор зашёл о нейросетях, и кто-то сказал: «Всё, что мы умеем — это классифицировать и предсказывать. Мы не умеем создавать новое. Машины не творческие».

Ян задумался. А что, если заставить две нейросети соревноваться? Что, если одна будет пытаться обмануть другую? Он достал ноутбук, прямо в баре начал писать код и к утру у него была работающая версия.

Это был момент истинной гениальности — не в лаборатории, не на суперкомпьютере, а в баре за кружкой пива.

Конфликт: Почему машины не умели творить

До GAN всё, что умели нейросети — это распознавать и классифицировать. Они смотрели на картинку и говорили: «Это кот», «Это не кот». Они были как искусствоведы, которые могут отличить Пикассо от Матисса, но сами нарисовать не могут.

Задача генерации (создания нового) казалась неразрешимой. Потому что «правильного ответа» нет. Как проверить, хорошую картинку нарисовала нейросеть или плохую? Кто судья?

Можно было попробовать обучить сеть срисовывать с примеров. Но тогда она просто запоминала картинки и выдавала их копии с шумом. Это не творчество, это плагиат.

Нужен был принципиально новый подход.

Развязка: Гениальная дуэль

Ян Гудфеллоу придумал гениально простую конструкцию. Он взял две нейросети и поставил их играть в игру с нулевой суммой (кто выиграл, тот и съел).

Игрок 1: Генератор (Художник-фальшивомонетчик).

Это нейросеть, которая учится создавать подделки. На входе она получает случайный шум (набор случайных чисел). На выходе выдаёт картинку. Сначала это просто цветной мусор, абстракция, похожая на телевизионные помехи.

Игрок 2: Дискриминатор (Критик-искусствовед).

Это нейросеть, которая учится отличать подлинники от подделок. Ей показывают и настоящие фотографии из базы данных, и творения Генератора. Она должна сказать: «Настоящее» или «Подделка».

Правила игры:

— Генератор создаёт подделку.

— Дискриминатор оценивает: «Фу, ерунда, видно же, что подделка».

— Генератор получает по носу (штраф) и подкручивает свои настройки, чтобы в следующий раз обмануть критика лучше.

— Дискриминатор тоже учится: если его обманули, он подкручивает свои настройки, чтобы стать более придирчивым.

— И так миллион раз.

Эволюция:

— Раунд 1: Генератор рисует серое месиво. Дискриминатор смеётся: «Это подделка, 100%».

— Раунд 1000: Генератор рисует что-то, отдалённо похожее на размытое лицо. Дискриминатор говорит: «Сомнительно, но похоже на подделку».

— Раунд 1 000 000: Генератор рисует идеальное фото человека. Дискриминатор в панике: «Я не знаю… может, настоящее?».

Когда игра доходит до конца, наступает равновесие Нэша (то самое, из «Игр разума» про Джона Нэша): Дискриминатор уже не может отличить подделку от оригинала, потому что Генератор научился создавать идеальные копии.

Инсайт: Почему это гениально

Гениальность GAN в том, что критик обучается вместе с художником.

В обычной нейросети ты фиксируешь «правильные ответы» и учишь сеть под них подстраиваться. В GAN нет фиксированных ответов. Есть только вечная гонка вооружений. Дискриминатор становится всё более требовательным, и Генератор вынужден становиться всё более искусным, чтобы его обмануть.

Это как если бы ты учился рисовать, а твоим учителем был самый придирчивый искусствовед в мире, который с каждым твоим успехом становился бы ещё придирчивее.

Эволюция: От размытых лиц к фотореализму

Первые GAN в 2014 году выдавали ужасное качество. Лица были размытыми, с плавающими глазами, с тремя ушами. Но сообщество исследователей подхватило идею, и началась эволюция.

DCGAN (2015): Добавили свёрточные слои (те, что из AlexNet). Картинки стали чётче, появилась структура.

CycleGAN (2017): Научилась превращать лошадей в зебр, лето в зиму, эскизы в фото. Без парных примеров! Просто берёт два набора картинок (сотни фото лошадей и сотни фото зебр) и учится переводить одно в другое.

StyleGAN (2018) от NVIDIA: Прорыв года. StyleGAN научилась генерировать лица в супер-высоком разрешении, с контролем стиля. Хочешь, чтобы у человека были веснушки? Пожалуйста. Хочешь изменить возраст? Легко. Хочешь повернуть голову? Без проблем. Именно StyleGAN лежит в основе сайта ThisPersonDoesNotExist.com.

BigGAN (2019): Научилась генерировать не только лица, а вообще всё: собак, цветы, еду, пейзажи. Качество стало почти фотографическим.

Темная сторона: Империя фейков

Как только GAN научились создавать неотличимые от реальности изображения, начался кошмар.

1. Deepfakes (дипфейки).

Самое известное (и страшное) применение. Люди начали накладывать лица знаменитостей на порно-ролики. Потом — лица политиков на видео, где они говорят то, чего никогда не говорили. Потом — лица обычных людей. Теперь любой человек с видеокартой может «заставить» любого другого человека сказать что угодно.

2. Фейковые новости.

Представь фотографию, на которой президенты пожимают руки врагам. Или солдаты совершают военные преступления. Фотошоп раньше был заметен. StyleGAN создаёт фото, которые не отличить от настоящих. Доказательств больше не существует.

3. Кража личности.

Мошенники создают фейковые профили в соцсетях с лицами несуществующих людей. Они выглядят привлекательно, ведут переписку, втираются в доверие и выманивают деньги. Жертва даже не подозревает, что человека, с которым она общалась месяц, не существует в природе.

4. Порноместь.

Самый страшный пункт. Люди начали генерировать порнографические изображения с лицами своих бывших партнёров или одноклассников, а потом распространять их в интернете. Жертва не может доказать, что это не она, потому что фото выглядит идеально реалистично.

Борьба: Охотники за фейками

Парадокс GAN в том, что те же самые технологии используются для борьбы с фейками.

— Создаются детекторы дипфейков, которые ищут микро-артефакты: как бьётся пульс на видео (дипфейки не умеют имитировать кровоток), как отражается свет в глазах, как двигаются ресницы.

— Компании вроде Microsoft вкладывают миллионы в создание «водяных знаков» для настоящих видео.

— Учёные разрабатывают методы, которые позволяют определить, какой именно GAN создал картинку (у каждой архитектуры есть свой «почерк»).

Но это гонка без финиша. Как только детекторы учатся ловить один тип фейков, GAN учатся их обходить.

Наследие: Эра пост-правды

Что оставили нам GAN?

Для творчества:

Теперь любой человек может создать иллюстрацию, дизайн, концепт-арт. Достаточно набросать эскиз, а GAN дорисует в любом стиле. Дизайнеры используют GAN для генерации текстур, узоров, вариаций. Это инструмент, как фотошоп, только в тысячу раз мощнее.

Для науки:

GAN используют для создания новых молекул (лекарств), для улучшения снимков МРТ (делают чётче без дополнительного облучения), для восстановления старых фотографий.

Для общества:

Мы вступили в эру, где видеть — больше не значит верить. Фотография перестала быть доказательством. Любое изображение может быть подделкой. Это требует от нас нового уровня критического мышления.

Твой ход: Четыре урока от GAN

— Конкуренция рождает качество. Генератор и Дискриминатор стали гениями только потому, что соревновались. В жизни тоже: здоровый конфликт, обратная связь от «критика» делает тебя лучше.

— Творчество — это комбинация. GAN не создают из ничего. Они комбинируют элементы из миллионов примеров. Твоё творчество — тоже переработка опыта. Не бойся заимствовать и смешивать.

— Инструмент нейтрален. Молотком можно забить гвоздь, а можно разбить голову. GAN можно использовать для лечения рака и для разрушения репутаций. Выбор за тобой.

— Проверяй реальность. Если увидел скандальное фото или видео в интернете — не верь сразу. Ищи источник, смотри на детали, включай критическое мышление. Мир стал сложнее.

P.S.

Знаешь, что сказал Ян Гудфеллоу, когда его спросили про дипфейки и фейковые новости?

«Я создавал технологию, чтобы машины могли творить. Я не думал о злоумышленниках. Но науку не остановить. Мы должны учить людей думать, а не запрещать технологии».

Генератор и Критик продолжают свою вечную дуэль. Художник становится лучше, критик — придирчивее. И кто знает, может быть, через несколько лет мы уже не сможем отличить реальность от вымысла никогда.

Глава 11. ResNet: Почему «остаточные связи» позволили строить сети толщиной в сотни слоев

Крючок: Парадокс строителя

Представь, что ты строишь небоскрёб. Ты начинаешь с 10 этажей. Здание стоит крепко. Ты добавляешь ещё 10 — всё хорошо. Ещё 10 — стоит.

Но вдруг, когда ты доходишь до 50 этажей, происходит странное: нижние этажи начинают проседать. Бетон трескается. Здание становится менее устойчивым, чем 40-этажное. Хотя по логике, чем выше здание, тем оно прочнее (если строить правильно), но здесь что-то идёт не так.

Примерно такая же проблема встала перед исследователями нейросетей в 2015 году. Казалось бы, чем больше слоёв в нейросети, тем умнее она должна быть. Ведь больше параметров, больше возможностей для абстракций.